filmov

tv

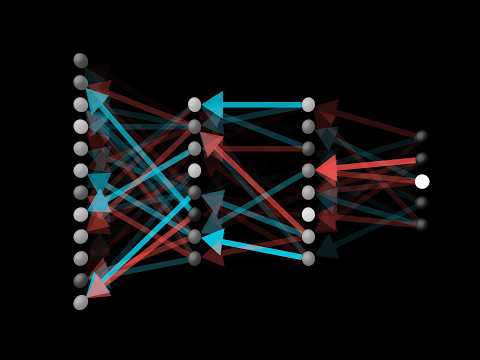

La rétropropagation (backprop) | Intelligence artificielle 43

Показать описание

Le succès des réseaux de neurones semblent s'expliquer essentiellement par leur capacité à se prêter à la descente de gradient. Et ça, ça vient d'un algorithme en particulier : l'algorithme de rétropropagation, aussi appelé backpropagation ou backprop.

La formule du savoir (mon livre) :

A Roadmap for the Value-Loading Problem

Moi en podcast avec Mr Phi :

La formule du savoir (mon livre) :

A Roadmap for the Value-Loading Problem

Moi en podcast avec Mr Phi :

La rétropropagation (backprop) | Intelligence artificielle 43

La BACK-PROPAGATION - DEEP LEARNING 8

[Deepmath] 9.1. Principe de la rétropropagation

Backpropagation, step-by-step | DL3

Intelligence Artificielle [12.12] : Apprentissage automatique - rétropropagation

Machine Learning Crash Course: Neural Networks Backprop

What is Back Propagation

What is Backpropagation | Artificial Intelligence & Machine Learning Basics for Beginners 11

Formation Backpropagation

Neural Networks explained in 60 seconds!

Intelligence Artificielle: Rétropropagation au niveau d'un neurone 008

Backpropagation calculus | DL4

Backpropagation Explained for Beginners

Unleashing the Power of Backpropagation: Training Neural Networks to Perfection

Backpropagation Explained

Types of Neural Networks #shorts

[Deepmath] 9.2. Exemples de rétropropagation

Backpropagation explained | Part 1 - The intuition

Reti Neurali - Back Propagation | Teoria di Deep Learning | Deep Learning Tutorial Italiano

Beren Millidge: Learning in the brain beyond backprop

#1 Solved Example Back Propagation Algorithm Multi-Layer Perceptron Network by Dr. Mahesh Huddar

Backpropagation explained | Part 5 - What puts the 'back' in backprop?

Backpropagation in Neural Networks | Back Propagation Algorithm with Examples | Simplilearn

Data Science Pronto! - Backpropagation

Комментарии

0:19:28

0:19:28

0:31:56

0:31:56

![[Deepmath] 9.1. Principe](https://i.ytimg.com/vi/HveXkSWDeYQ/hqdefault.jpg) 0:14:36

0:14:36

0:12:47

0:12:47

![Intelligence Artificielle [12.12]](https://i.ytimg.com/vi/NgwvhX0xBs0/hqdefault.jpg) 0:23:49

0:23:49

0:02:28

0:02:28

0:08:00

0:08:00

0:02:13

0:02:13

0:30:11

0:30:11

0:01:00

0:01:00

0:05:25

0:05:25

0:10:18

0:10:18

0:18:31

0:18:31

0:03:33

0:03:33

0:10:54

0:10:54

0:00:25

0:00:25

![[Deepmath] 9.2. Exemples](https://i.ytimg.com/vi/_AsV7EQw78I/hqdefault.jpg) 0:07:29

0:07:29

0:10:56

0:10:56

0:09:44

0:09:44

0:47:35

0:47:35

0:14:31

0:14:31

0:14:10

0:14:10

0:06:48

0:06:48

0:03:16

0:03:16