filmov

tv

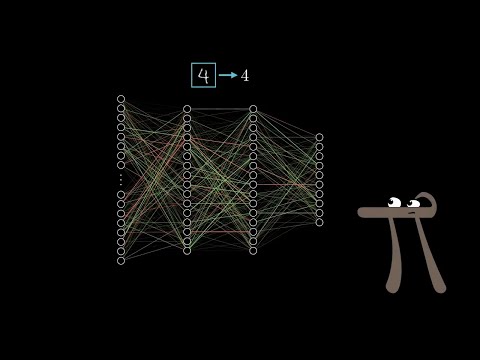

Самое простое объяснение нейросети

Показать описание

ВНИМАНИЕ!!!

В этом ролике я максимально просто расскажу что такое нейросети и как работает перцептрон. А еще я выдам готовый алгоритм обратного распространения ошибки БЕЗ матанализа и заумных слов. В конце ролика я покажу готовую программу с такой нейросетью, которую написал в Qt на языке C++ без использования специальных библиотек.

Таймкоды:

00:00 - введение

00:54 - датасет MNIST

01:36 - перцептрон

01:45 - нейроны

04:46 - веса и смещения

06:29 - функция активации

07:36 - прямое распространение

08:44 - обучение

10:14 - эпоха обучения

11:43 - вычисление ошибки

14:13 - обновленеи весов и смещений

15:36 - нерйросеть в Qt

#перцептрон #нейросеть #Qt

В этом ролике я максимально просто расскажу что такое нейросети и как работает перцептрон. А еще я выдам готовый алгоритм обратного распространения ошибки БЕЗ матанализа и заумных слов. В конце ролика я покажу готовую программу с такой нейросетью, которую написал в Qt на языке C++ без использования специальных библиотек.

Таймкоды:

00:00 - введение

00:54 - датасет MNIST

01:36 - перцептрон

01:45 - нейроны

04:46 - веса и смещения

06:29 - функция активации

07:36 - прямое распространение

08:44 - обучение

10:14 - эпоха обучения

11:43 - вычисление ошибки

14:13 - обновленеи весов и смещений

15:36 - нерйросеть в Qt

#перцептрон #нейросеть #Qt

Самое простое объяснение нейросети

Как НА САМОМ ДЕЛЕ работает нейросеть?

НЕЙРОСЕТИ - самое понятное объяснение + пишем нейросеть с нуля....

[DeepLearning | видео 1] Что же такое нейронная сеть?

Что такое нейронные сети? ДЛЯ НОВИЧКОВ / Про IT / Geekbrains

Нейронные сети за 10 минут

ИИ, машинное обучение, НЕЙРОСЕТИ, Что есть что? | БОЛЬШОЙ РАЗБОР...

Нейросети. Самое простое и понятное объяснение с нуля с примерами....

Как работают нейросети? Самое простое объяснение

Простыми словами о том, как работает AI

Как работает ChatGPT: объясняем нейросети просто

Твоя ПЕРВАЯ НЕЙРОСЕТЬ на Python с нуля! | За 10 минут :3

Нейросеть создала собственный язык, который ученые не могут расшифровать...

Нейронные сети. Детальный гайд

Как устроены искусственные нейронные сети? — Научпок

Математика это не Ислам

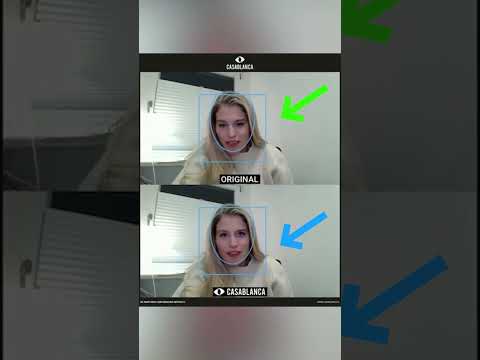

Полезная Нейросеть для Удаленщика. ИИ захватывает МИР на уровне реального времени в (AI) REAL LIFE...

нейронные сети за 5 минут простыми словами

Реакция на низкие баллы егэ

Как работают нейросети?

Как работают сверточные нейронные сети | #13 нейросети на Python...

Делаю нейросеть с нуля

Учим Нейронные Сети за 1 час! | Python Tensorflow & PyTorch YOLO

Midjourney. КАК работают НЕЙРОСЕТИ. Простое объяснение и быстрая генерация локации...

Комментарии

0:16:30

0:16:30

0:10:00

0:10:00

0:14:47

0:14:47

0:19:00

0:19:00

0:06:55

0:06:55

0:09:56

0:09:56

0:19:52

0:19:52

1:45:45

1:45:45

0:00:56

0:00:56

0:04:37

0:04:37

0:39:04

0:39:04

0:18:31

0:18:31

0:01:53

0:01:53

0:11:42

0:11:42

0:05:07

0:05:07

0:00:21

0:00:21

0:00:32

0:00:32

0:05:28

0:05:28

0:00:27

0:00:27

0:00:38

0:00:38

0:19:37

0:19:37

0:17:17

0:17:17

0:50:06

0:50:06

0:00:30

0:00:30